在當(dāng)今大數(shù)據(jù)時(shí)代,億級(jí)數(shù)據(jù)的聚合處理已成為許多企業(yè)和組織的核心需求。傳統(tǒng)的數(shù)據(jù)處理方法在面對(duì)海量數(shù)據(jù)時(shí)往往效率低下,甚至無法完成任務(wù)。因此,開發(fā)一種高效、可擴(kuò)展的億級(jí)聚合數(shù)據(jù)處理方法至關(guān)重要。

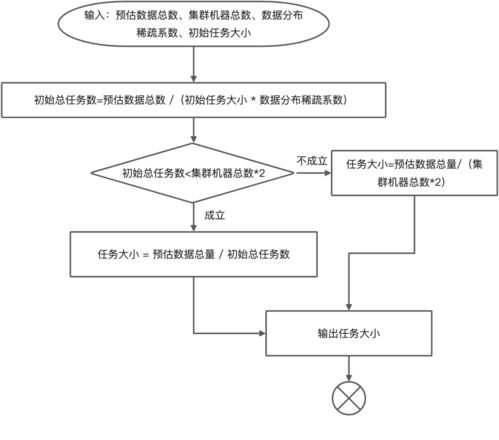

數(shù)據(jù)分片是處理億級(jí)聚合數(shù)據(jù)的基礎(chǔ)。通過將數(shù)據(jù)劃分為多個(gè)較小的片段,可以并行處理這些片段,顯著提高處理速度。例如,可以使用哈希分片或范圍分片策略,將數(shù)據(jù)均勻分布到多個(gè)計(jì)算節(jié)點(diǎn)上。這種方法不僅減少了單個(gè)節(jié)點(diǎn)的負(fù)載,還充分利用了分布式系統(tǒng)的計(jì)算能力。

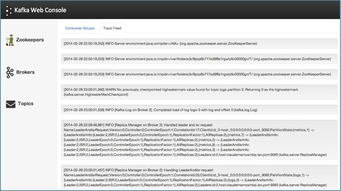

采用分布式計(jì)算框架是實(shí)現(xiàn)高效聚合的關(guān)鍵。Apache Spark、Flink等現(xiàn)代計(jì)算框架提供了強(qiáng)大的聚合功能,支持內(nèi)存計(jì)算和容錯(cuò)機(jī)制。以Spark為例,其RDD(彈性分布式數(shù)據(jù)集)和DataFrame API可以輕松實(shí)現(xiàn)分組、求和、計(jì)數(shù)等聚合操作,并通過優(yōu)化執(zhí)行計(jì)劃提升性能。對(duì)于億級(jí)數(shù)據(jù),Spark的分布式聚合能夠?qū)⑷蝿?wù)分解為多個(gè)階段,并在集群中并行執(zhí)行,大大縮短處理時(shí)間。

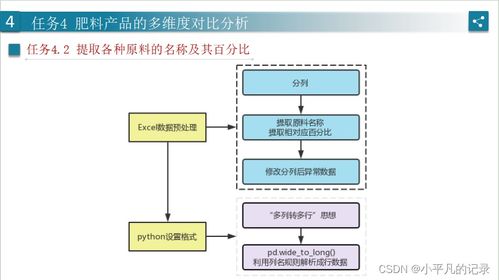

數(shù)據(jù)預(yù)處理和索引優(yōu)化也是不可忽視的環(huán)節(jié)。在聚合之前,對(duì)數(shù)據(jù)進(jìn)行清洗、去重和壓縮,可以減少不必要的計(jì)算開銷。同時(shí),為常用聚合字段建立索引,如使用布隆過濾器或B樹索引,可以加速數(shù)據(jù)查找和聚合過程。例如,在時(shí)間序列數(shù)據(jù)聚合中,按時(shí)間戳建立索引可以快速定位特定時(shí)間范圍的數(shù)據(jù),提升聚合效率。

資源管理和監(jiān)控是確保系統(tǒng)穩(wěn)定運(yùn)行的重要保障。通過動(dòng)態(tài)資源分配和負(fù)載均衡,系統(tǒng)可以根據(jù)數(shù)據(jù)量和計(jì)算需求自動(dòng)調(diào)整資源使用。監(jiān)控工具如Prometheus或Grafana可以幫助實(shí)時(shí)跟蹤聚合任務(wù)的進(jìn)度和性能指標(biāo),及時(shí)發(fā)現(xiàn)并解決瓶頸問題。

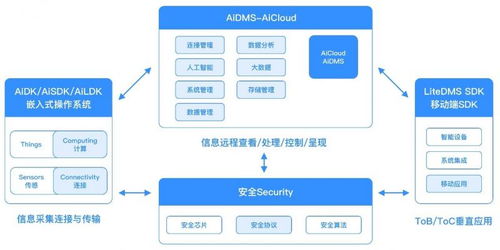

通過數(shù)據(jù)分片、分布式計(jì)算框架、數(shù)據(jù)預(yù)處理與索引優(yōu)化以及資源管理監(jiān)控,我們可以構(gòu)建一種高效處理億級(jí)聚合數(shù)據(jù)的方法。這種方法不僅提升了數(shù)據(jù)處理速度,還保證了系統(tǒng)的可擴(kuò)展性和穩(wěn)定性,適用于電商、金融、物聯(lián)網(wǎng)等多個(gè)領(lǐng)域的大數(shù)據(jù)應(yīng)用場(chǎng)景。